TensorFlow练习(六)——Classification分类学习

2017-08-30 16:36

363 查看

分类和回归的区别在于输出变量的类型上。

通俗理解定量输出是回归,或者说是连续变量预测; 定性输出是分类,或者说是离散变量预测。如预测房价这是一个回归任务; 把东西分成几类, 比如猫狗猪牛,就是一个分类任务。

首先准备数据(MNIST库),MNIST库是手写体数字库,差不多是这样子的

数据中包含55000张训练图片,每张图片的分辨率是28×28,所以我们的训练网络输入应该是28×28=784个像素数据。

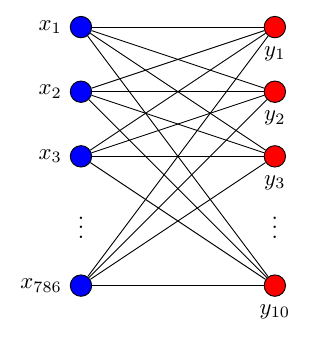

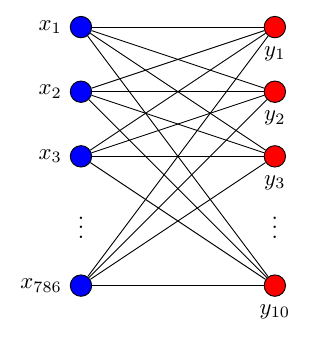

神经网络结构图:

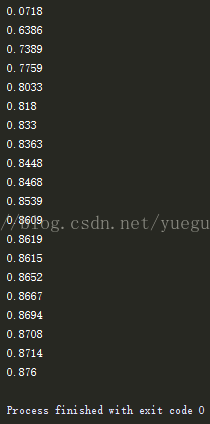

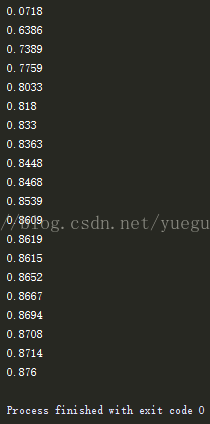

运行结果:

通俗理解定量输出是回归,或者说是连续变量预测; 定性输出是分类,或者说是离散变量预测。如预测房价这是一个回归任务; 把东西分成几类, 比如猫狗猪牛,就是一个分类任务。

首先准备数据(MNIST库),MNIST库是手写体数字库,差不多是这样子的

数据中包含55000张训练图片,每张图片的分辨率是28×28,所以我们的训练网络输入应该是28×28=784个像素数据。

import tensorflow as tf

import numpy as np

from tensorflow.examples.tutorials.mnist import input_data

import matplotlib.pyplot as plt

# number 1 to 10 data

mnist = input_data.read_data_sets('MNIST_data',one_hot=True) # 如果没有这个数据包会去网上帮你下载下来。

def add_layer(inputs,in_size,out_size,activation_function=None): # 输入值,输入的大小,输出的大小,激励函数

Weights = tf.Variable(tf.random_normal([in_size,out_size])) #定义矩阵 随机变量生成初始的时候会比全0的好

# 定义weights为一个in_size行, out_size列的随机变量矩阵

biases = tf.Variable(tf.zeros([1,out_size]) + 0.1) # 推荐初始值不为0

Wx_plus_b = tf.matmul(inputs,Weights) + biases

# 当激励函数为None时,输出就是当前的预测值——Wx_plus_b

# 不为None时,就把Wx_plus_b传到activation_function()函数中得到输出。

if activation_function is None: # 线性关系,就不需要再加非线性方程

outputs = Wx_plus_b

else:

outputs = activation_function(Wx_plus_b)

return outputs

def compute_accuracy(v_xs,v_ys):

global prediction # 定义全局变量

y_pre = sess.run(prediction, feed_dict={xs: v_xs}) # 用xs生成预测值 1行10列,介于0、1之间的数

correct_prediction = tf.equal(tf.argmax(y_pre, 1), tf.argmax(v_ys, 1)) # 概率最大值的位置是不是等于真是数据中1的位置

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32)) # 计算这组数据到底多少对的多少错的

result = sess.run(accuracy, feed_dict={xs: v_xs, ys: v_ys})

return result # 输出百分比

xs = tf.placeholder(tf.float32,[None,784]) # 每一张图片有784个像素点

ys = tf.placeholder(tf.float32,[None,10]) # 有十个数字输出

# 调用add_layer函数搭建一个最简单的训练网络结构,只有输入层和输出层。

prediction = add_layer(xs,784,10,activation_function=tf.nn.softmax) # softmax用来做分类

# 其中输入数据是784个特征,输出数据是10个特征,激励采用softmax函数,网络结构图是这样子的

cross_entropy = tf.reduce_mean(-tf.reduce_sum(ys*tf.log(prediction),

reduction_indices=[1])) # loss函数(即最优化目标函数)选用交叉熵函数。交叉熵用来衡量预测值和真实值的相似程度

train_step = tf.train.GradientDescentOptimizer(0.5).minimize(cross_entropy)

# train方法采用梯度下降法 优化器 目标,最小化误差

init = tf.global_variables_initializer()

sess = tf.Session()

sess.run(init)

for i in range(2000):

batch_xs,batch_ys = mnist.train.next_batch(100) # 现在开始train,从下载好的database每次只取100张图片,免得数据太多训练太慢。

sess.run(train_step,feed_dict={xs:batch_xs,ys:batch_ys})

if i % 50 ==0:

print(compute_accuracy(mnist.test.images,mnist.test.labels))

plt.show()神经网络结构图:

运行结果:

相关文章推荐

- Tensorflow学习--Classification 分类

- tensorflow学习-示例1(MNIST数据集合上的softmax分类模型)

- TensorFlow基础笔记(3) cifar10 分类学习

- Tensorflow实战学习(十九)【序列分类、IMDB影评分类】

- 输出包含共同元素的变量值 分类: python 小练习 python基础学习 2014-03-11 13:55 188人阅读 评论(0) 收藏

- tensorflow 学习:用CNN进行图像分类

- 图像分类之特征学习ECCV-2010 Tutorial: Feature Learning for Image Classification

- Chinese-Text-Classification,用卷积神经网络基于 Tensorflow 实现的中文文本分类。

- TensorFlow损失函数(loss function) 2017-08-14 11:32 125人阅读 评论(0) 收藏 举报 分类: 深度学习及TensorFlow实现(10) 版权声明:

- 卷积神经网络用语句子分类---Convolutional Neural Networks for Sentence Classification 学习笔记

- 十二.TensorFlow之分类学习

- tensorflow练习1:利用神经网络进行分类

- TensorFlow学习笔记:构建多分类任务模型(未完)

- 猜数字 分类: python 小练习 python基础学习 2013-06-20 15:16 160人阅读 评论(0) 收藏

- tensorflow 学习笔记(十二)- 用别人训练好的模型来进行图像分类

- Tensorflow学习笔记--使用迁移学习做自己的图像分类器(Inception v3)

- python中文编码转换 分类: python基础学习 python 小练习 2013-10-11 17:22 331人阅读 评论(0) 收藏

- fileinput模块 分类: python基础学习 python 小练习 python Module 2013-08-15 17:18 417人阅读 评论(0) 收藏

- 生成器介绍 分类: python 小练习 python基础学习 divide into python 2013-12-31 21:17 226人阅读 评论(0) 收藏

- 继承父类,调用父类中的方法 分类: python 小练习 python基础学习 2014-01-10 17:54 325人阅读 评论(0) 收藏