CNN反向传播训练参数过程

2017-06-08 20:23

267 查看

一、前言

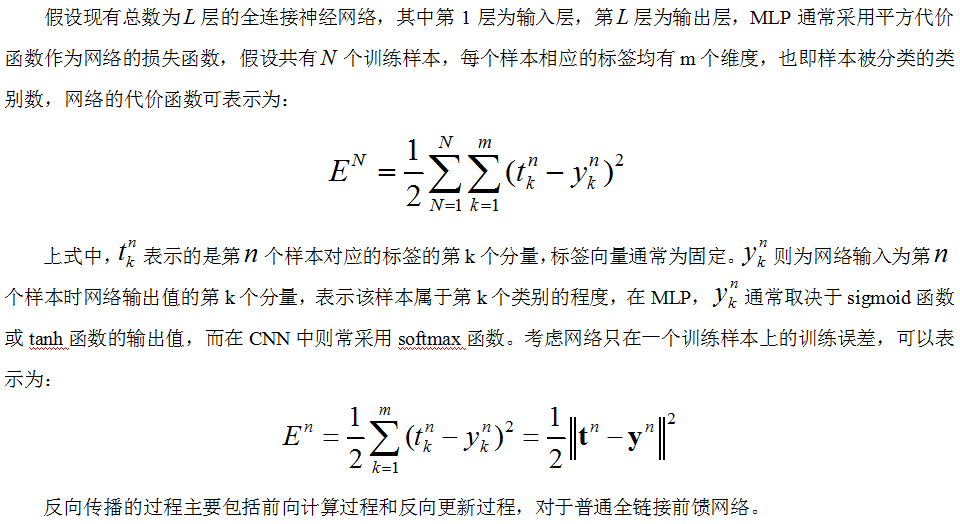

对于使用BP算法进行CNN参数训练的过程,网上已有很多资料,这里结合论文Notes on Convolutional Neural Networks, Jake Bouvrie以及一些博客资料做总结,并附加上一些自己的理解。二、神经网络BP算法

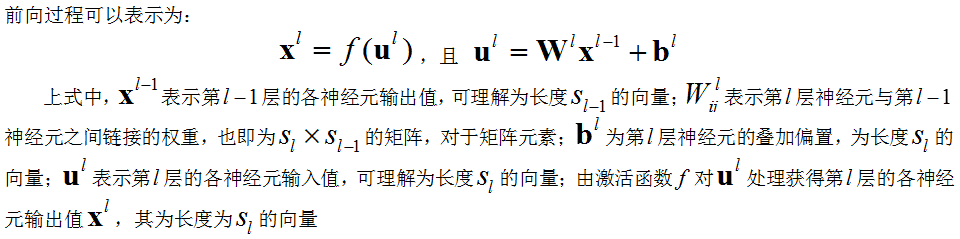

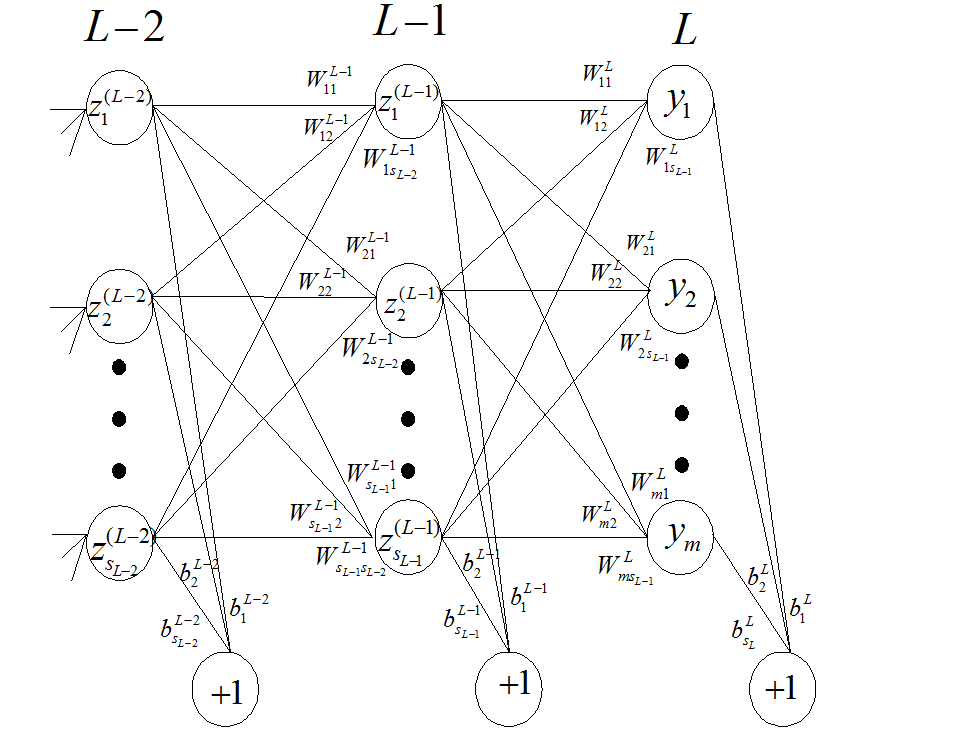

2.1、前向传播过程

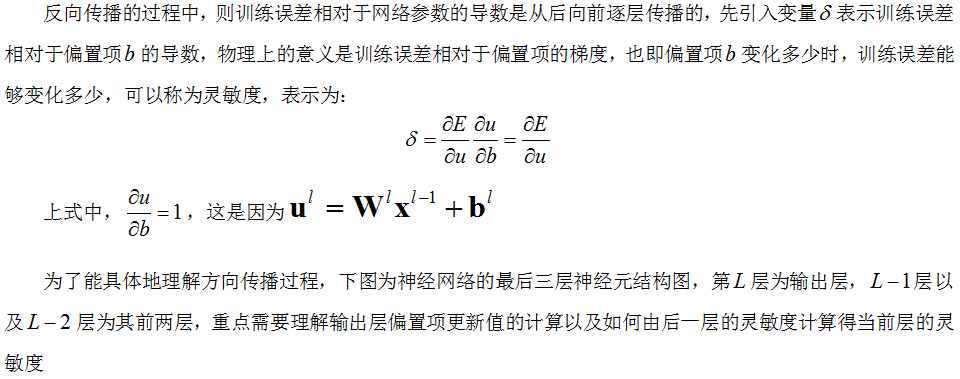

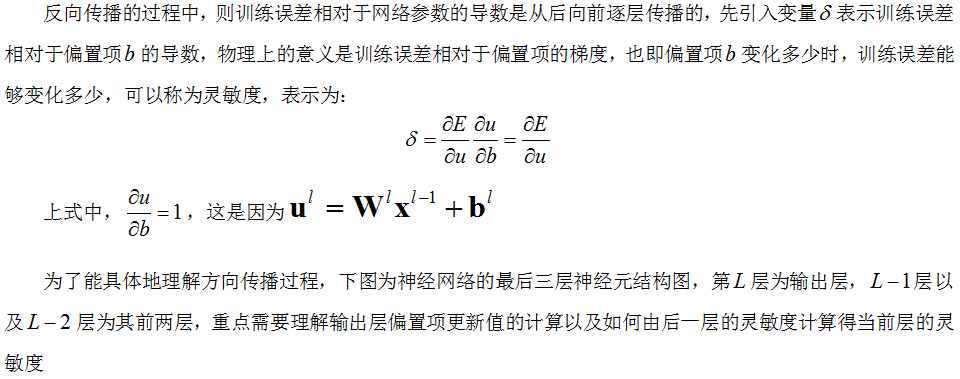

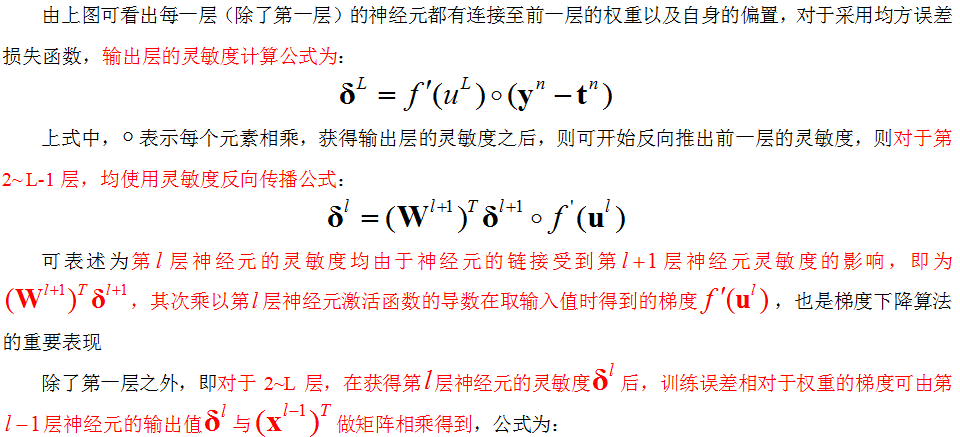

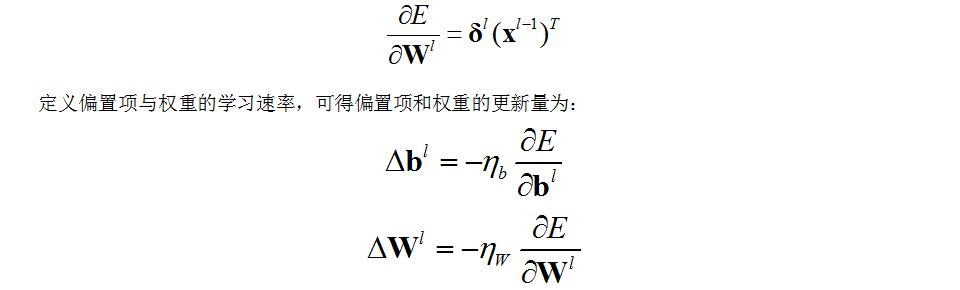

2.2、反向传播过程

三、BP算法在CNN中的应用

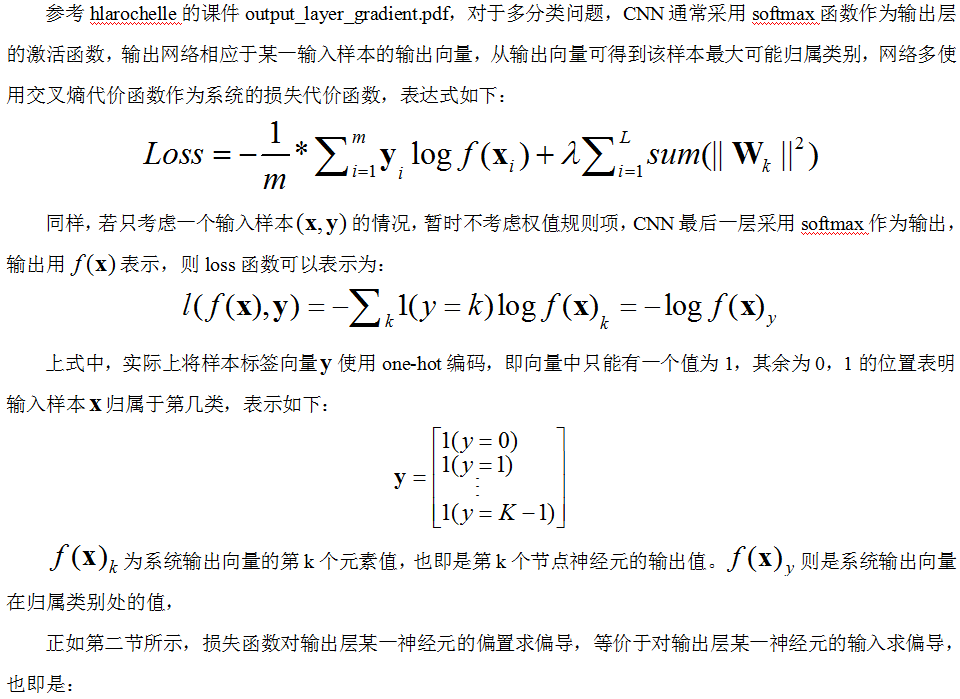

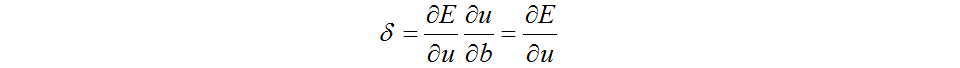

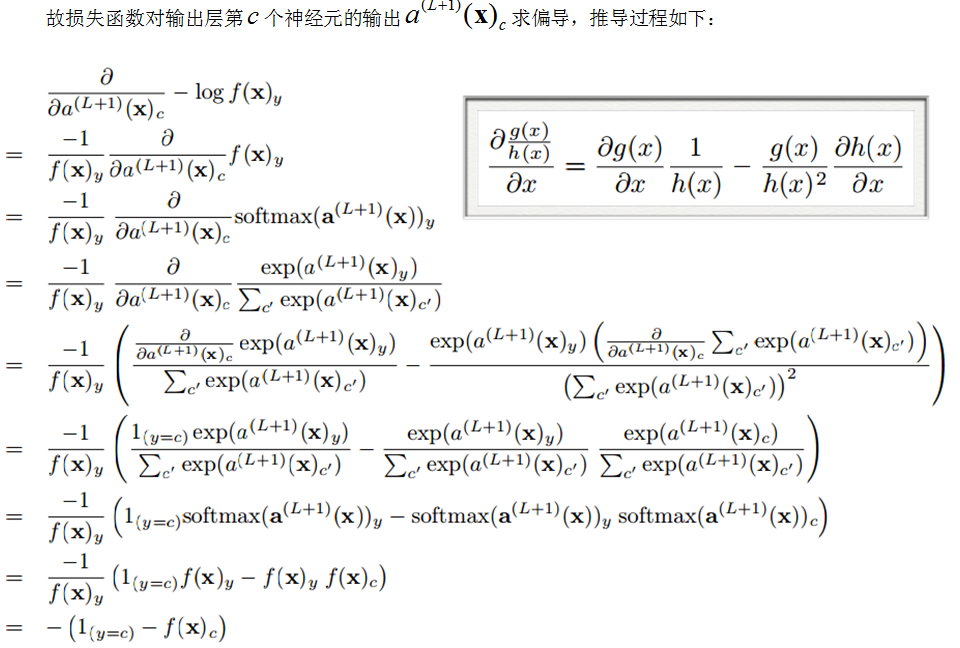

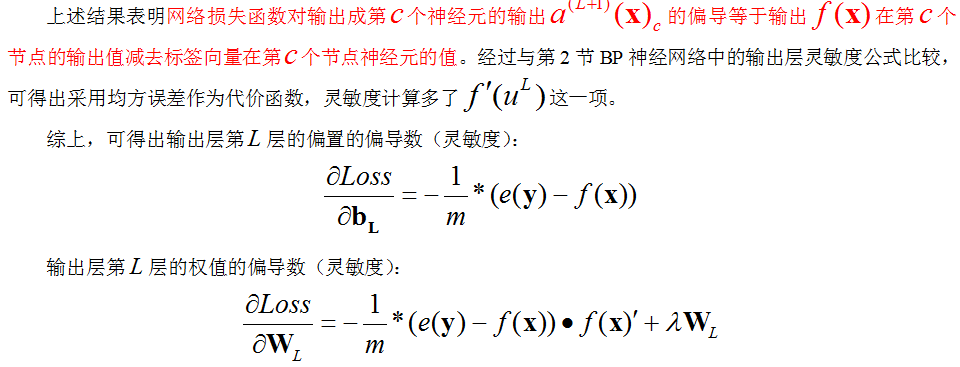

3.1、采用softmax交叉熵代价函数时输出层灵敏度计算

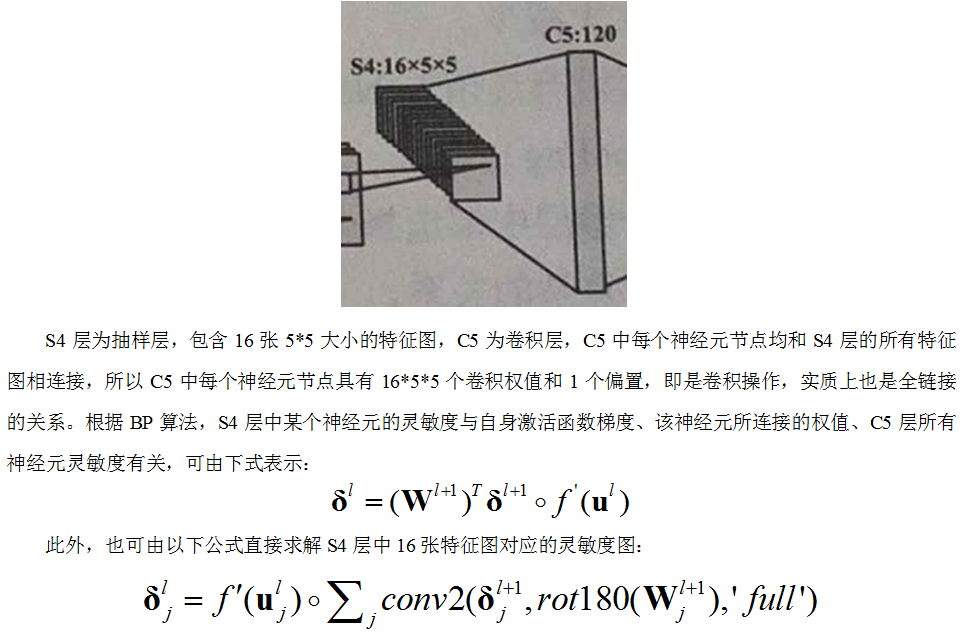

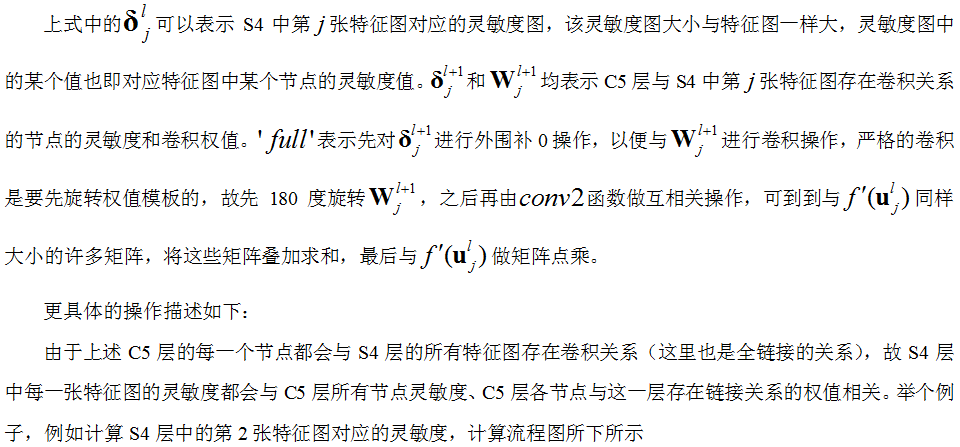

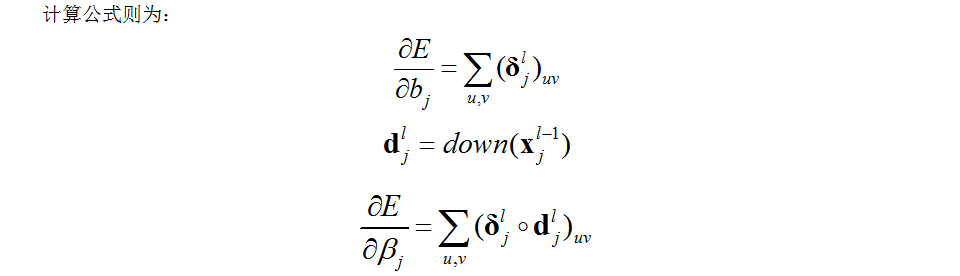

3.2、全连接层的前一层为池化层时,求池化层的灵敏度计算及权值与偏置的梯度

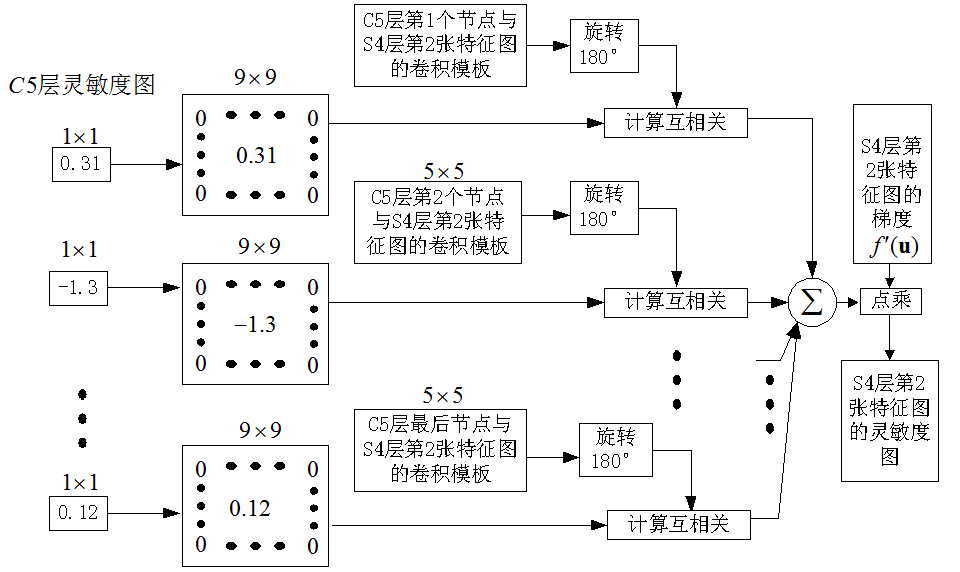

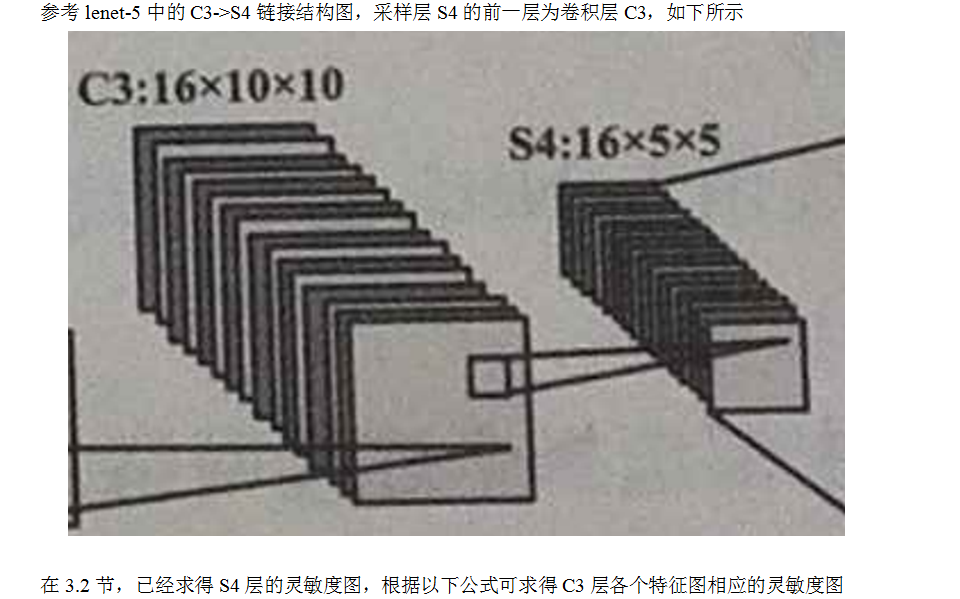

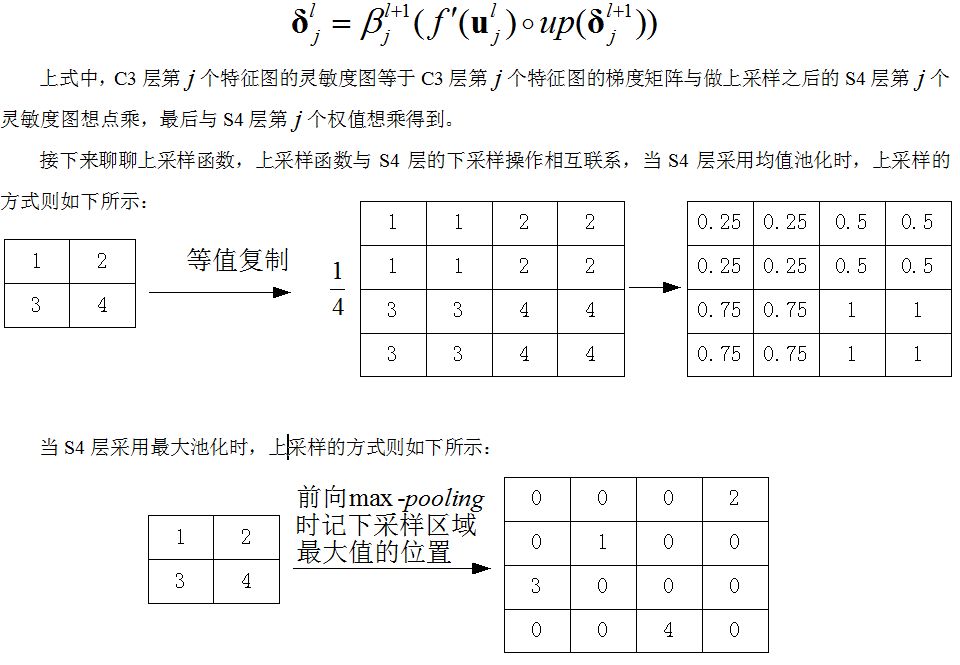

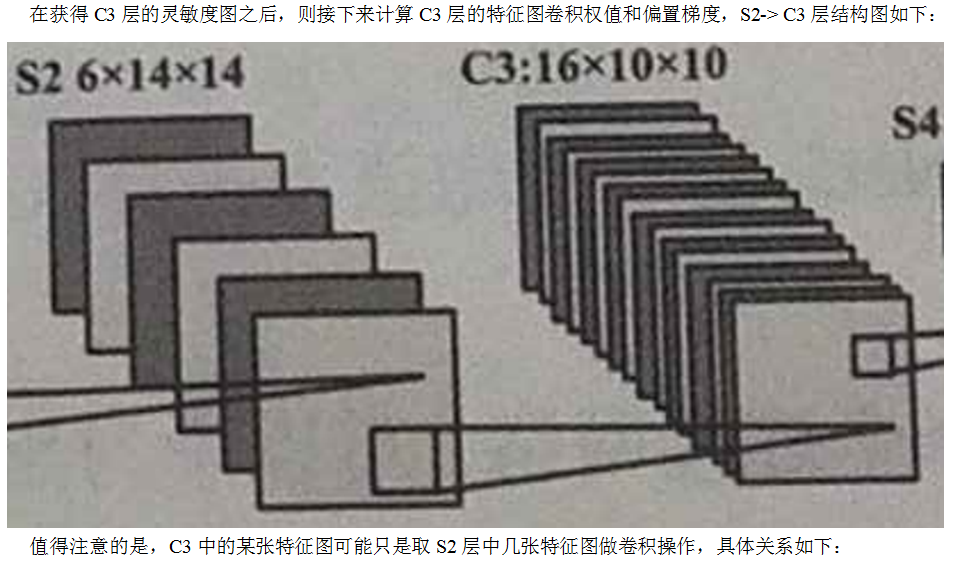

3.3、池化层的前一层为卷积层时,求卷积层的灵敏度及权重与偏置的梯度

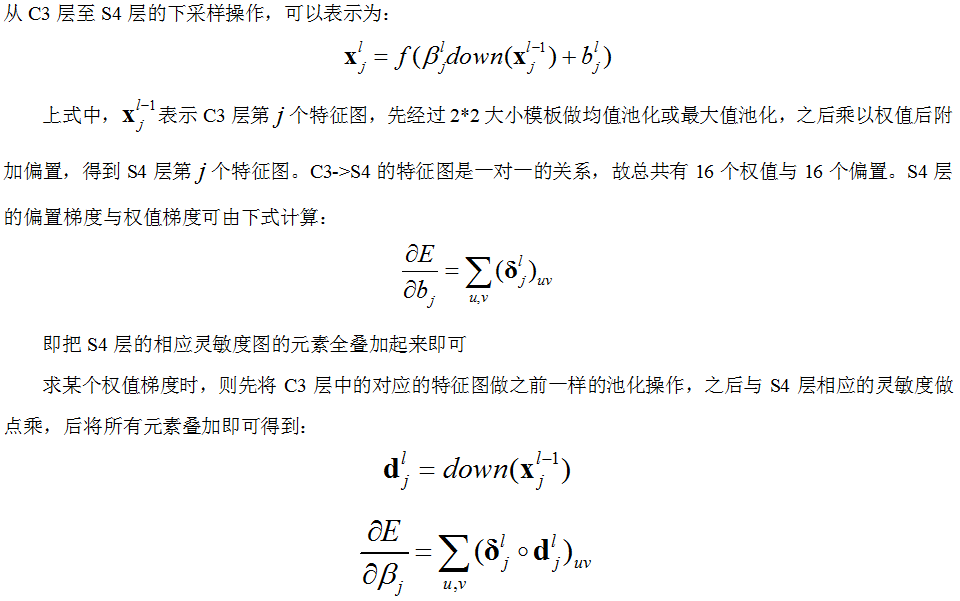

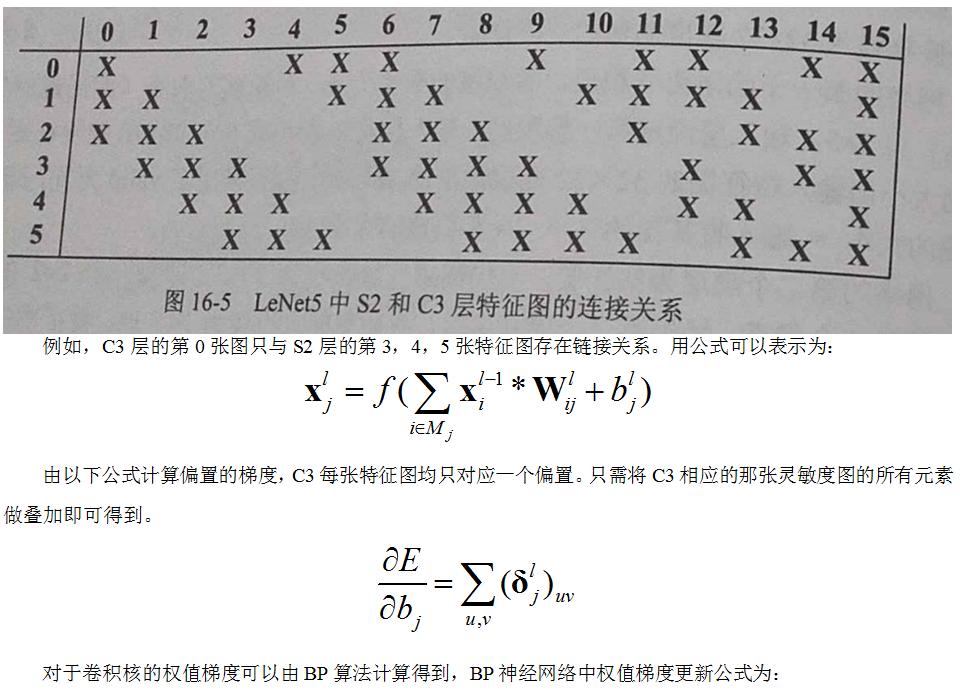

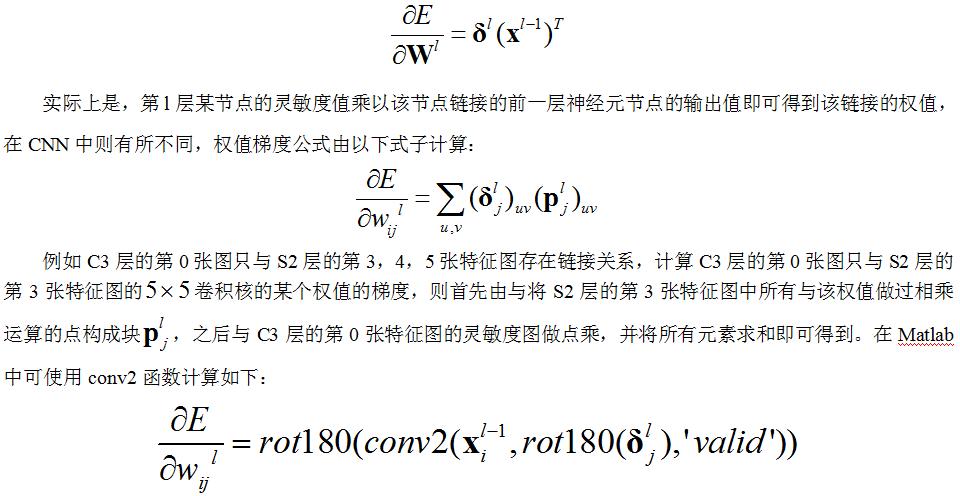

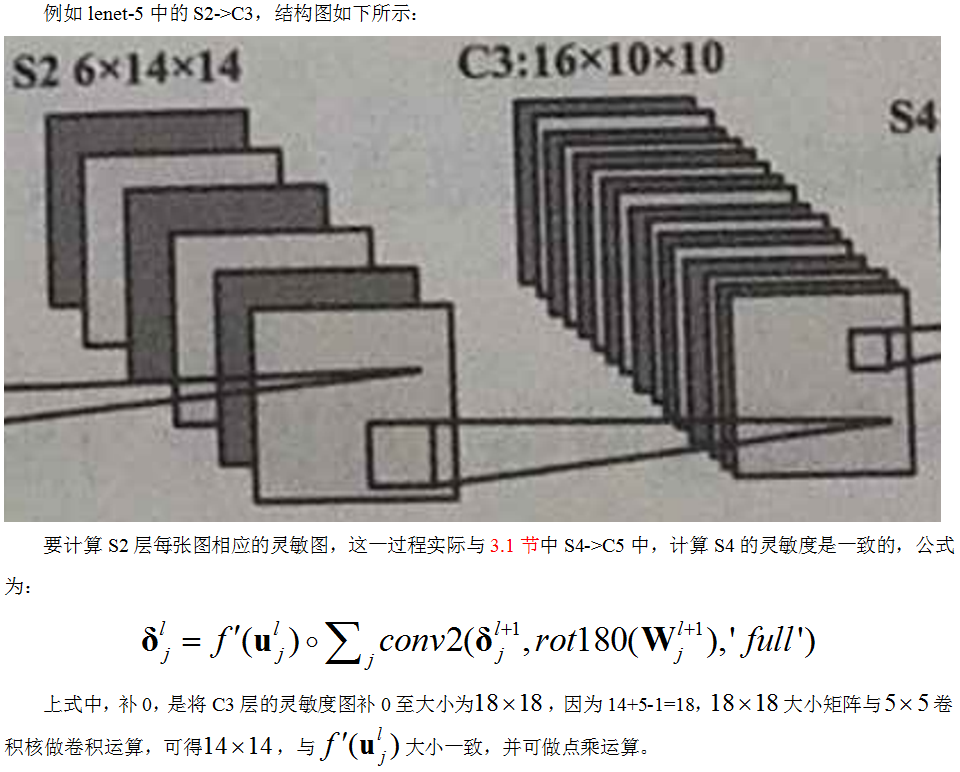

3.4、卷积层的前一层为池化层时,求卷积层灵敏度及卷积核权值梯度与偏置梯度

四、参考资料

http://blog.csdn.net/evan123mg/article/details/40149457http://blog.csdn.net/zouxy09/article/details/9993371

《视觉机器学习20讲》中CNN章节

相关文章推荐

- CNN中的梯度的求法和反向传播过程

- 编写C语言版本的卷积神经网络CNN之三:CNN的误差反向传播过程

- DeepLearning tutorial(2)机器学习算法在训练过程中保存参数

- Convolutional Neurons Network 训练参数与连接数计算过程

- BP(反向传播)算法和CNN反向传播算法推导(转载)

- 深度学习之问题记录--fast r-cnn训练过程

- 深度学习21天实战Caffe学习笔记--笔记5--caffe中前向传播、反向传播及最优化求解过程

- 使用反向传播训练神经网络

- YOLO模型训练可视化训练过程中的中间参数

- caffe loss以及正则项反向传播过程

- python查看CNN训练模型参数

- DeepLearning tutorial(2)机器学习算法在训练过程中保存参数

- DeepLearning tutorial(2)机器学习算法在训练过程中保存参数

- 深度学习基础:反向传播即BP算法的推导过程

- faster rcnn训练过程内存占用

- CNN+caffe学习4:自己训练网络全过程

- DeepLearning tutorial(2)机器学习算法在训练过程中保存参数

- 深度学习21天实战Caffe学习笔记--笔记5--caffe中前向传播、反向传播及最优化求解过程

- CNN反向传播公式推导

- Faster RCNN代码理解(Python) ---训练过程