开源 | 哈佛大学NLP组开源神经机器翻译工具包OpenNMT:已达到生产可用水平

2017-03-16 13:33

1211 查看

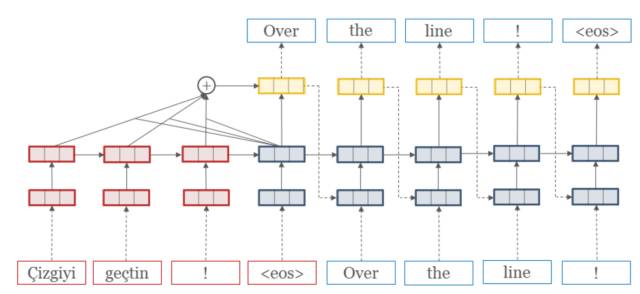

神经机器翻译是近段时间以来推动机器翻译发展的主要推动力。今天,哈佛大学自然语言处理研究组(Harvard NLP)宣布开源了其研发的神经机器翻译系统 OpenNMT,该系统使用了 Torch 数学工具包。该研究组在官网上表示该系统已经达到生产可用的水平(industrial-strength)。

官网:http://opennmt.net

代码:https://github.com/opennmt/opennmt

演示:https://demo-pnmt.systran.net

Docker 容器:https://hub.docker.com/r/harvardnlp/opennmt

OpenNMT 可以像主要的翻译服务提供商的已投入生产的系统那样使用。该系统简单易用,易于扩展,同时也能维持效率和当前最佳的翻译准确度。

其特性包括:

简单的通用型接口,仅需要源文件和目标文件;

为高性能 GPU 训练进行了速度和内存优化;

可以提升翻译性能的最新研究的特性;

有多个语言对的预训练好的模型(即将到来);

允许其它序列生成任务的扩展,比如归纳总结和图像到文本生成。

安装

OpenNMT 仅需要一次 vanilla torch/cutorch 安装。它要使用 nn、nngraph 和 cunn。有(CUDA)Docker 容器可选。

快速启动

OpenNMT 包含三条指令:

1)预处理数据

th preprocess.lua -train_src data/src-train.txt -train_tgt data/tgt-train.txt -valid_src data/src-val.txt -valid_tgt data/tgt-val.txt -save_data

data/demo

2)训练模型

th train.lua -data data/demo-train.t7 -save_model model

3)翻译句子

th translate.lua -model model_final.t7 -src data/src-test.txt -output pred.txt

查看指南了解更多:http://opennmt.github.io/Guide

研究

其中主要的模型基于论文 Neural Machine Translation by Jointly Learning to Align and Translate Bahdanau et al. ICLR 2015 和 Effective Approaches to Attention-based Neural Machine Translation,

Luong et al. EMNLP 2015。

在基本模型上,还有大量可选项,这都要感谢 SYSTRAN(http://www.systransoft.com/)的出色工作。特别地,下面是一些实现的功能:

Effective Approaches to Attention-based Neural Machine Translation . Luong et al., EMNLP 2015.

Character-based Neural Machine Translation. Costa-Jussa and Fonollosa, ACL 2016.

Compression of Neural Machine Translation Models via Pruning . See et al., COLING 2016.

Sequence-Level Knowledge Distillation . Kim and Rush., EMNLP 2016.

Deep Recurrent Models with Fast Forward Connections for Neural Machine Translation . Zhou et al, TACL 2016.

Guided Alignment Training for Topic-Aware Neural Machine Translation . Chen et al., arXiv:1607.01628.

Linguistic Input Features Improve Neural Machine Translation . Senrich et al., arXiv:1606.02892

声明

OpenNMT 的实现使用了以下项目的代码:

Andrej Karpathy 的 char-rnn:https://github.com/karpathy/char-rnn

Wojciech Zaremba 的 LSTM:https://github.com/wojzaremba/lstm

Element RNN 库:https://github.com/Element-Research/rnn

证书

MIT

原文地址:http://mp.weixin.qq.com/s?__biz=MzA3MzI4MjgzMw==&mid=2650721602&idx=3&sn=4f80dae1dfe49c1151288a60731d4b40&chksm=871b093cb06c802abc2c4f3dc7c2989caad155308667da292888a26c6297be28c37018e40769&scene=0#rd

官网:http://opennmt.net

代码:https://github.com/opennmt/opennmt

演示:https://demo-pnmt.systran.net

Docker 容器:https://hub.docker.com/r/harvardnlp/opennmt

OpenNMT 可以像主要的翻译服务提供商的已投入生产的系统那样使用。该系统简单易用,易于扩展,同时也能维持效率和当前最佳的翻译准确度。

其特性包括:

简单的通用型接口,仅需要源文件和目标文件;

为高性能 GPU 训练进行了速度和内存优化;

可以提升翻译性能的最新研究的特性;

有多个语言对的预训练好的模型(即将到来);

允许其它序列生成任务的扩展,比如归纳总结和图像到文本生成。

安装

OpenNMT 仅需要一次 vanilla torch/cutorch 安装。它要使用 nn、nngraph 和 cunn。有(CUDA)Docker 容器可选。

快速启动

OpenNMT 包含三条指令:

1)预处理数据

th preprocess.lua -train_src data/src-train.txt -train_tgt data/tgt-train.txt -valid_src data/src-val.txt -valid_tgt data/tgt-val.txt -save_data

data/demo

2)训练模型

th train.lua -data data/demo-train.t7 -save_model model

3)翻译句子

th translate.lua -model model_final.t7 -src data/src-test.txt -output pred.txt

查看指南了解更多:http://opennmt.github.io/Guide

研究

其中主要的模型基于论文 Neural Machine Translation by Jointly Learning to Align and Translate Bahdanau et al. ICLR 2015 和 Effective Approaches to Attention-based Neural Machine Translation,

Luong et al. EMNLP 2015。

在基本模型上,还有大量可选项,这都要感谢 SYSTRAN(http://www.systransoft.com/)的出色工作。特别地,下面是一些实现的功能:

Effective Approaches to Attention-based Neural Machine Translation . Luong et al., EMNLP 2015.

Character-based Neural Machine Translation. Costa-Jussa and Fonollosa, ACL 2016.

Compression of Neural Machine Translation Models via Pruning . See et al., COLING 2016.

Sequence-Level Knowledge Distillation . Kim and Rush., EMNLP 2016.

Deep Recurrent Models with Fast Forward Connections for Neural Machine Translation . Zhou et al, TACL 2016.

Guided Alignment Training for Topic-Aware Neural Machine Translation . Chen et al., arXiv:1607.01628.

Linguistic Input Features Improve Neural Machine Translation . Senrich et al., arXiv:1606.02892

声明

OpenNMT 的实现使用了以下项目的代码:

Andrej Karpathy 的 char-rnn:https://github.com/karpathy/char-rnn

Wojciech Zaremba 的 LSTM:https://github.com/wojzaremba/lstm

Element RNN 库:https://github.com/Element-Research/rnn

证书

MIT

原文地址:http://mp.weixin.qq.com/s?__biz=MzA3MzI4MjgzMw==&mid=2650721602&idx=3&sn=4f80dae1dfe49c1151288a60731d4b40&chksm=871b093cb06c802abc2c4f3dc7c2989caad155308667da292888a26c6297be28c37018e40769&scene=0#rd

相关文章推荐

- 神经机器翻译中的领域自适应问题 Domain adaptation for NMT

- 一窥谷歌神经机器翻译模型真面貌 其底层框架开源

- 神经机器翻译(Neural Machine Translation)系列教程 - (一)神经机器翻译-开源项目

- 谷歌神经网络机器翻译NMT:人人可利用TensorFlow快速建立翻译模型

- 机器学习(二十三)——Beam Search, NLP机器翻译常用评价度量, 模型驱动 vs 数据驱动

- 机器学习语料,深度学习语料,神经网络语料,nlp语料,机器视觉语料,持续更新

- Seq2Seq非常好的代码(机器翻译、对话生成等):漫谈四种神经网络序列解码模型【附示例代码】

- 谷歌翻译整合神经网络:机器翻译实现颠覆性突破

- 探究神经机器翻译中的注意力机制:指哪儿打哪儿,还是指哪儿打一片?

- 【NLP】机器翻译常用评价标准 (BLEU & METEOR)

- TensorFlow 神经机器翻译教程-TensorFlow Neural Machine Translation Tutorial

- 一些开源的统计机器翻译系统简要介绍

- 神经网络机器翻译模型介绍

- 融合统计机器翻译特征的蒙汉神经网络机器翻译技术

- 【NLP】一次性生成完整句子!Salesforce发布全球首个「全并行」神经翻译系统

- 机器阅读理解 / 知识库 / 深度学习 / 对话系统 / 神经机器翻译 | 本周值得读

- 无平行文本照样破解密码,CipherGAN有望提升机器翻译水平

- 机器智能将会在2029年达到人类的水平

- 打算翻译机器学习工具包--SHOGUN使用文档

- 最大熵开源——openNLP MaxEnt