docker资源限制及应用

2017-01-02 21:56

579 查看

防伪码:乘风破浪会有时,直挂云帆济沧海

一、本文将介绍 cgroup 如何做到内存,cpu 和 io 速率的隔离

本文用脚本运行示例进程,来验证 Cgroups 关于 cpu、内存、io 这三部分的隔离效果。

测试机器环境

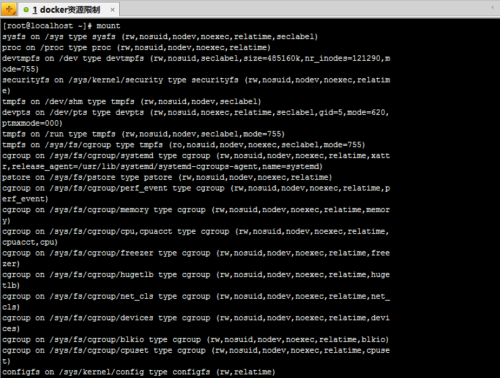

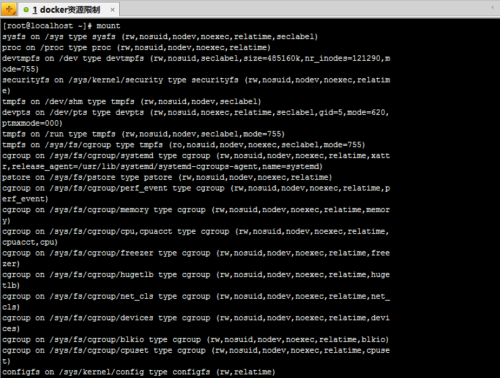

执行 mount 命令查看 cgroup 的挂载点

从上图可以看到 cgroup 挂载在/sys/fs/cgroup 目录

groups 可以限制 blkio、cpu、cpuacct、cpuset、devices、freezer、memory、net_cls、ns 等系

统的资源,以下是主要子系统的说明:

blkio 这个子系统设置限制每个块设备的输入输出控制。例如:磁盘,光盘以及 usb 等等。

cpu 这个子系统使用调度程序为 cgroup 任务提供 cpu 的访问。

cpuacct 产生 cgroup 任务的 cpu 资源报告。

cpuset 如果是多核心的 cpu,这个子系统会为cgroup 任务分配单独的 cpu 和内存。

devices 允许或拒绝 cgroup 任务对设备的访问。

freezer 暂停和恢复 cgroup 任务。

memory 设置每个 cgroup 的内存限制以及产生内存资源报告。

net_cls 标记每个网络包以供 cgroup 方便使用,它通过使用等级识别符(classid)标记网络数

据包,从而允许 Linux 流量控制程序(TC:Traffic Controller)识别从具体 cgroup 中生成

的数据包。

ns:命名空间子系统

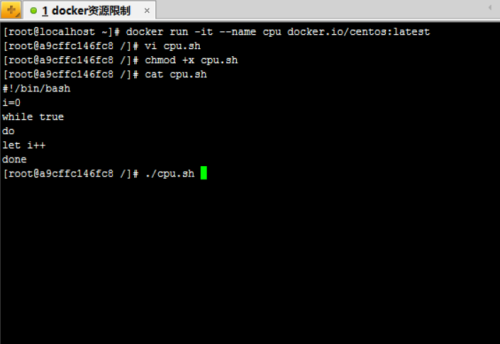

cgroups 管理进程 cpu 资源

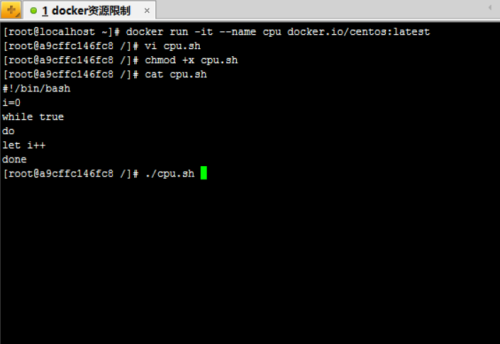

我们先看一个限制 cpu 资源的例子:

跑一个耗 cpu 的脚本

运行一个容器,在容器内创建脚本并运行脚本,脚本内容:

将容器切换到后台运行

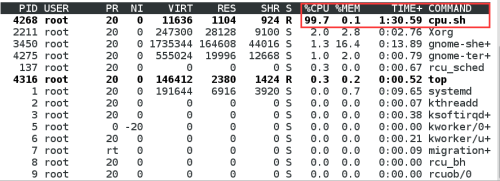

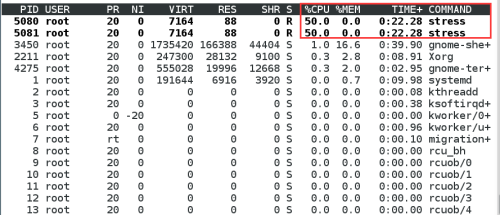

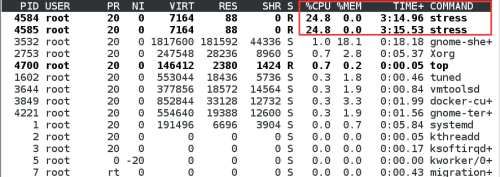

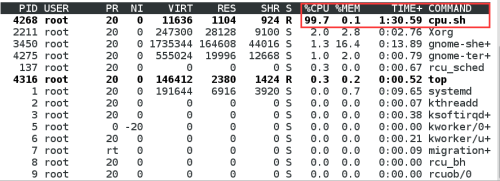

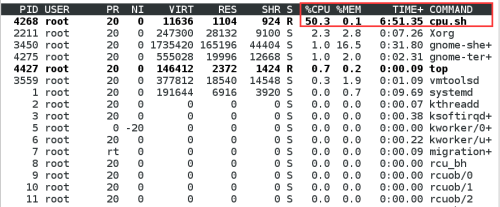

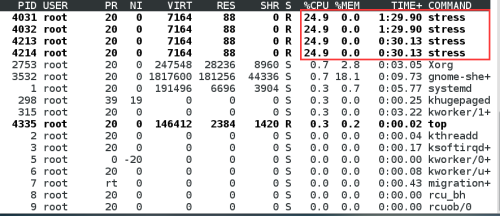

在宿主机上 top 可以看到这个脚本基本占了 90%多的 cpu 资源

下面用 cgroups 控制这个进程的 cpu 资源

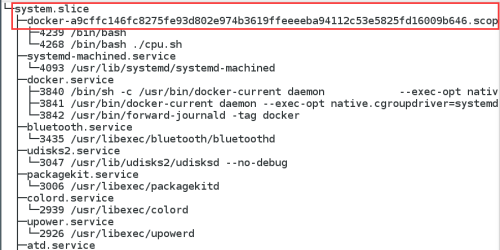

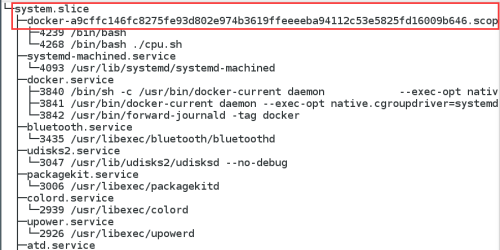

对于 centos7 来说,通过 systemd-cgls 来查看系统 cgroups tree:

#systemd-cgls

注:4239 就是我们所运行的容器 pid

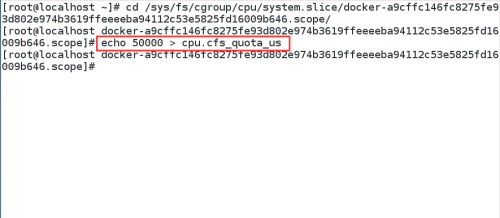

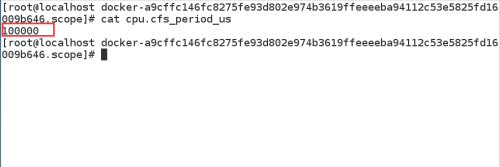

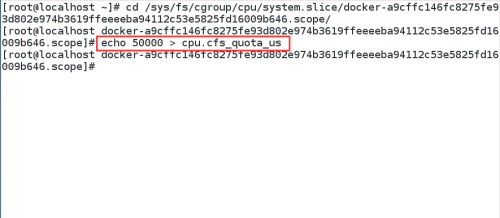

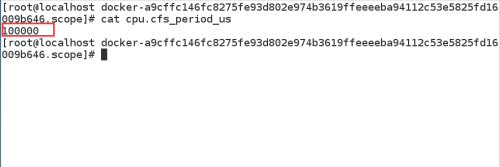

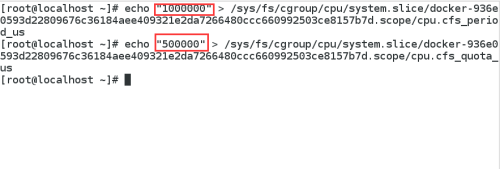

将 cpu.cfs_quota_us 设为 50000,相对于 cpu.cfs_period_us 的 100000 是 50%

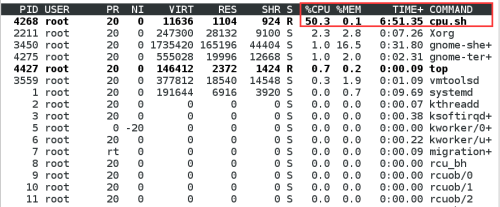

进入容器,再次执行脚本,打开宿主机的另一个终端执行 top 命令

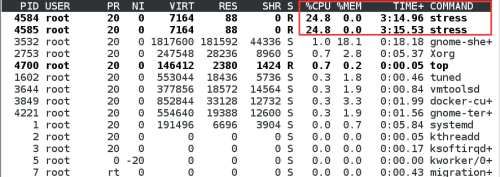

然后 top 的实时统计数据如下,cpu 占用率将近 50%,看来 cgroups 关于 cpu 的控制起了效果

CPU 资源控制

CPU 资源的控制也有两种策略,一种是完全公平调度 (CFS:CompletelyFair Scheduler)

策略,提供了限额和按比例分配两种方式进行资源控制;另一种是实时调度(Real-Time

Scheduler)策略,针对实时进程按周期分配固定的运行时间。配置时间都以微秒(μs)为

单位,文件名中用 us 表示。

CFS 调度策略下的配置

按权重比例设定 CPU 的分配

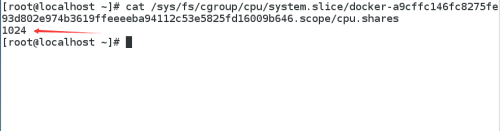

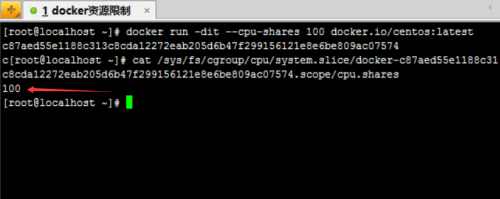

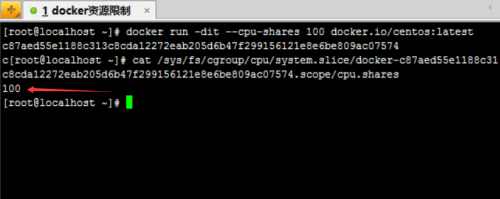

docker 提供了–cpu-shares 参数,在创建容器时指定容器所使用的 CPU 份额值。例如:

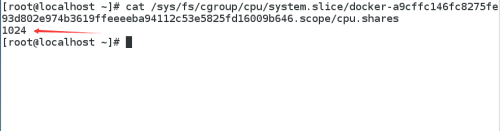

使用命令 docker run -tid –cpu-shares 100 镜像,创建容器,则最终生成的 cgroup 的 cpu 份额

配置可以下面的文件中找到:

cpu-shares 的值不能保证可以获得 1 个 vcpu 或者多少 GHz 的 CPU 资源,仅仅只是一个加权

值。

该加权值是一个整数(必须大于等于 2)表示相对权重,最后除以权重总和算出相对比例,

按比例分配 CPU 时间。

默认情况下,每个 docker 容器的 cpu 份额都是 1024。单独一个容器的份额是没有意义的,

只有在同时运行多个容器时,容器的 cpu 加权的效果才能体现出来。例如,两个容器 A、B

的 cpu 份额分别为 1000 和 500,在 cpu 进行时间片分配的时候,容器 A 比容器 B 多一倍的

机会获得 CPU 的时间片。如果容器 A 的进程一直是空闲的,那么容器 B 是可以获取比容器

A 更多的 CPU 时间片的。极端情况下,比如说主机上只运行了一个容器,即使它的 cpu 份额

只有 50,它也可以独占整个主机的 cpu 资源。

cgroups 只在容器分配的资源紧缺时,也就是说在需要对容器使用的资源进行限制时,才会

生效。因此,无法单纯根据某个容器的 cpu 份额来确定有多少 cpu 资源分配给它,资源分配

结果取决于同时运行的其他容器的 cpu 分配和容器中进程运行情况。

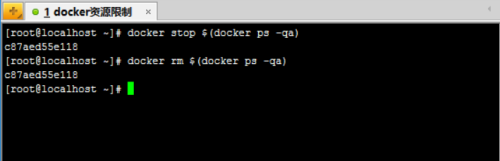

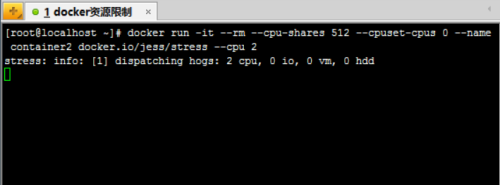

cpu-shares 演示案例:

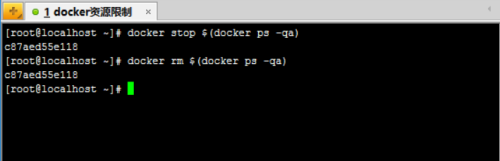

先删除 docker 主机上运行的容器

Docker 通过--cpu-shares 指定 CPU 份额

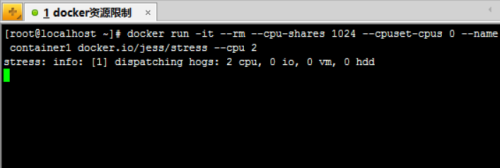

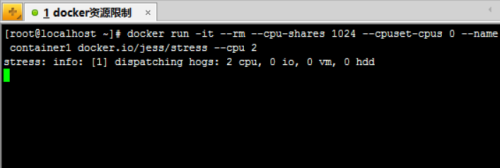

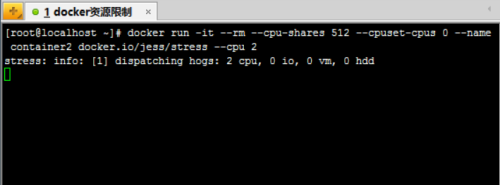

运行一个容器指定 cpu 份额为 1024

注:

--cpu-shares 指定 CPU 份额,默认就是 1024

--cpuset-cpus 可以绑定 CPU。例如,指定容器在--cpuset-cpus0,1 或--cpuset-cpus 0-3

--cpu 是 stress 命令的选项表示产生 n 个进程 每个进程都反复不停的计算随机数的平方根

stress 命令是 linux 下的一个压力测试工具。

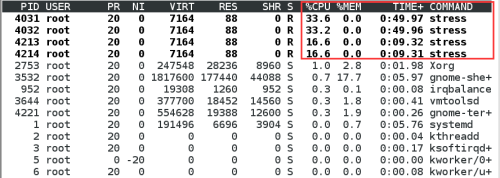

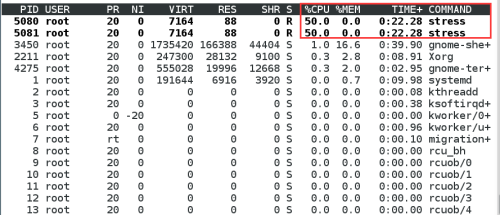

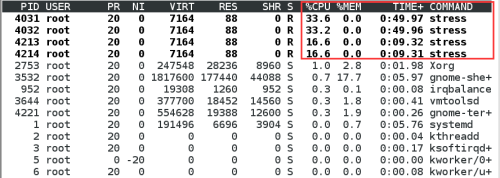

在 docker 宿主机上打开一个 terminal 执行 top

查看 top 的现实结果

可以看到 container1 的 CPU 占比为 1024/(1024+512)=2/3,container2 的 CPU 占比为

512/(1024+512)=1/3

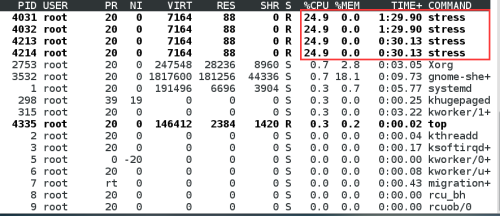

将 container1 的 cpu.shares 改为 512,

#echo “512” >/sys/fs/cgroup/cpu/system.slice/docker-<容器的完整长ID>/cpu.shares

可以看到两个容器的 CPU 占比趋于平均

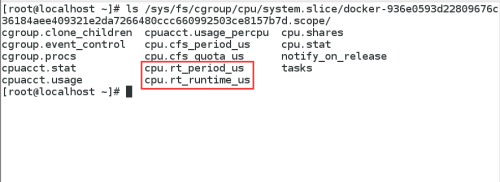

设定 CPU 使用周期使用时间上限

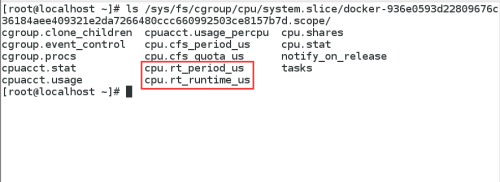

cgroups 里,可以用cpu.cfs_period_us 和 cpu.cfs_quota_us 来限制该组中的所有进程在单

位时间里可以使用的 cpu 时间。cpu.cfs_period_us 就是时间周期,默认为 100000,即百毫

秒。cpu.cfs_quota_us 就是在这期间内可使用的 cpu 时间,默认 -1,即无限制。

cpu.cfs_period_us:设定时间周期(单位为微秒(μs)),必须与 cfs_quota_us 配合使用。

cpu.cfs_quota_us :设定周期内最多可使用的时间(单位为微秒(μs))。这里的配置指 task

对单个 cpu 的使用上限。

举个例子,如果容器进程需要每 1 秒使用单个 CPU 的 0.2 秒时间,可以将 cpu-period 设置为

1000000(即 1 秒),cpu-quota 设置为 200000(0.2 秒)。

当然,在多核情况下,若 cfs_quota_us 是 cfs_period_us 的两倍,就表示在两个核上

完全使用 CPU,例如如果允许容器进程需要完全占用两个 CPU,则可以将 cpu-period 设置为

100000(即 0.1 秒),cpu-quota 设置为 200000(0.2 秒)。

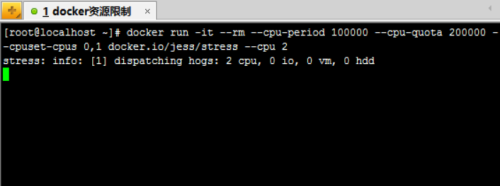

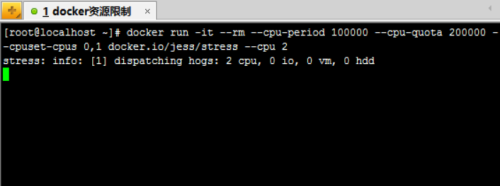

使用示例:

使用命令 docker run 创建容器

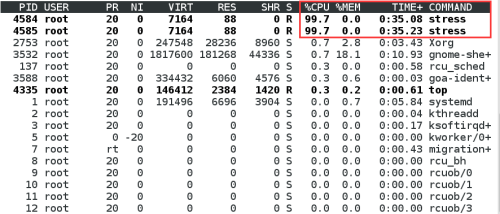

在宿主机上执行 top

从上图可以看到基本占了 100%的 cpu 资源

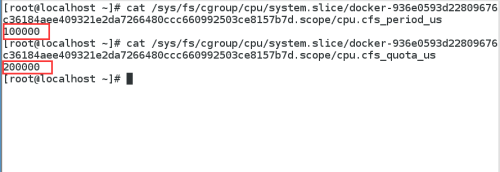

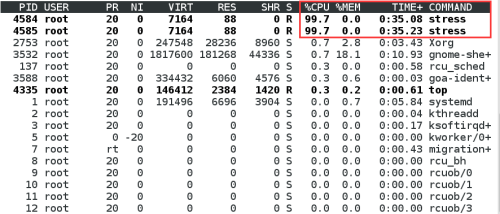

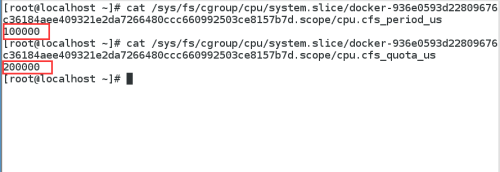

则最终生成的 cgroup 的 cpu 周期配置可以下面的目录中找到:

/sys/fs/cgroup/cpu/system.slice/docker-<容器的完整长ID>/

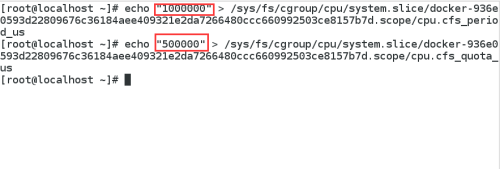

修改容器的 cpu.cfs_period_us 和 cpu.cfs_quota_us 值

执行 top 查看 cpu 资源

从上图可以看到基本占了 50%的 cpu 资源

RT 调度策略下的配置 实时调度策略与公平调度策略中的按周期分配时间的方法类似,也是

在周期内分配一个固定的运行时间。

cpu.rt_period_us :设定周期时间。

cpu.rt_runtime_us:设定周期中的运行时间。

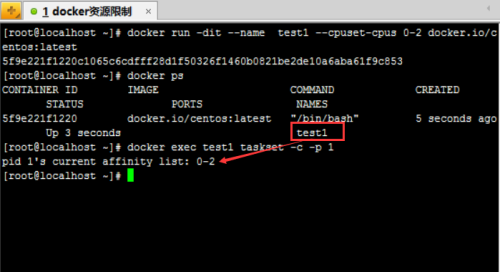

cpuset - CPU 绑定

对多核 CPU 的服务器,docker 还可以控制容器运行限定使用哪些 cpu 内核和内存节点,即

使用–cpuset-cpus 和–cpuset-mems 参数。对具有 NUMA 拓扑(具有多 CPU、多内存节点)的

服务器尤其有用,可以对需要高性能计算的容器进行性能最优的配置。如果服务器只有一个

内存节点,则–cpuset-mems 的配置基本上不会有明显效果

注:

现在的机器上都是有多个 CPU 和多个内存块的。以前我们都是将内存块看成是一大块内存,

所有 CPU 到这个共享内存的访问消息是一样的。但是随着处理器的增加,共享内存可能会

导致内存访问冲突越来越厉害,且如果内存访问达到瓶颈的时候,性能就不能随之增加。

NUMA(Non-Uniform MemoryAccess)就是这样的环境下引入的一个模型。比如一台机

器是有2个处理器,有4个内存块。我们将1个处理器和两个内存块合起来,称为一个NUMAnode,这样这个机器就会有两个 NUMAnode。在物理分布上,NUMA node 的处理器和内

存块的物理距离更小,因此访问也更快。比如这台机器会分左右两个处理器(cpu1, cpu2),

在每个处理器两边放两个内存块(memory1.1, memory1.2, memory2.1,memory2.2),这样

NUMA node1 的 cpu1 访问 memory1.1 和 memory1.2 就比访问memory2.1 和 memory2.2

更快。所以使用 NUMA 的模式如果能尽量保证本 node 内的 CPU 只访问本 node 内的内存

块,那这样的效率就是最高的。

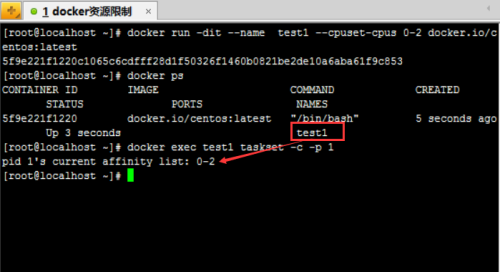

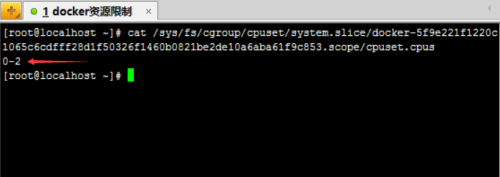

使用示例:

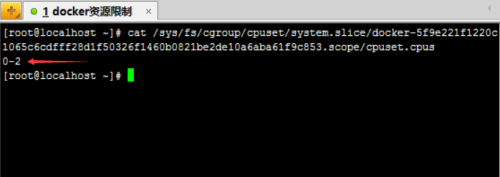

表示创建的容器只能用 0、1、2 这三个内核。最终生成的 cgroup 的 cpu 内核配置如下:

cpuset.cpus:在这个文件中填写 cgroup 可使用的 CPU 编号,如 0-2,16 代表 0、1、2 和 16

这 4 个 CPU。

cpuset.mems:与 CPU 类似,表示 cgroup 可使用的 memorynode,格式同上

通过 docker exec <容器 ID> taskset -c -p 1(容器内部第一个进程编号一般为 1),可以看到容器

中进程与 CPU 内核的绑定关系,可以认为达到了绑定 CPU 内核的目的。

总结:

CPU 配额控制参数的混合使用

当上面这些参数中时,cpu-shares 控制只发生在容器竞争同一个内核的时间片时,如果通过

cpuset-cpus 指定容器 A 使用内核 0,容器 B 只是用内核 1,在主机上只有这两个容器使用对

应内核的情况,它们各自占用全部的内核资源,cpu-shares 没有明显效果。

cpu-period、cpu-quota 这两个参数一般联合使用,在单核情况或者通过 cpuset-cpus 强制容

器使用一个 cpu 内核的情况下,即使 cpu-quota 超过 cpu-period,也不会使容器使用更多的

CPU 资源。

cpuset-cpus、cpuset-mems 只在多核、多内存节点上的服务器上有效,并且必须与实际的物

理配置匹配,否则也无法达到资源控制的目的。

在系统具有多个 CPU 内核的情况下,需要通过 cpuset-cpus 为容器 CPU 内核才能比较方便地

进行测试。

内存配额控制

和 CPU 控制一样,docker 也提供了若干参数来控制容器的内存使用配额,可以控制容器的

swap 大小、可用内存大小等各种内存方面的控制。主要有以下参数:

Docker 提供参数-m,--memory=""限制容器的内存使用量,如果不设置-m,则默认容器内存

是不设限的,容器可以使用主机上的所有空闲内存

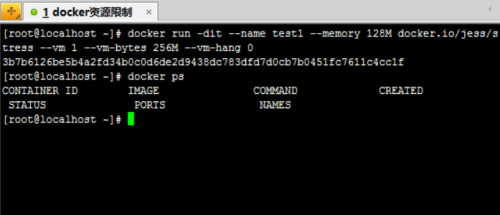

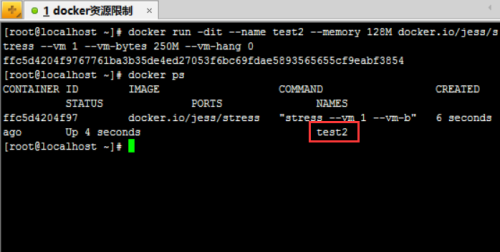

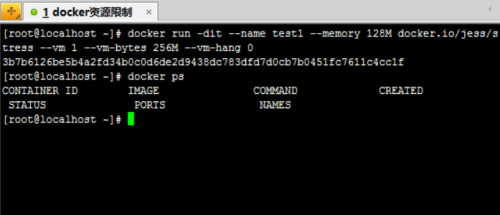

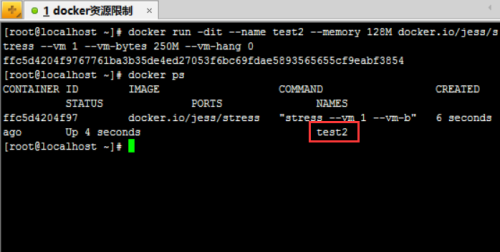

内存配额控制使用示例

设置容器的内存上限,参考命令如下所示

#docker run -dit --memory 128m 镜像

默认情况下,除了–memory 指定的内存大小以外,docker 还为容器分配了同样大小的 swap

分区,也就是说,上面的命令创建出的容器实际上最多可以使用 256MB 内存,而不是 128MB内存。如果需要自定义 swap 分区大小,则可以通过联合使用–memory–swap 参数来实现控

制。

可以发现,使用 256MB 进行压力测试时,由于超过了内存上限(128MB 内存+128MB swap),

进程被 OOM(out of memory)杀死。

使用 250MB 进行压力测试时,进程可以正常运行。

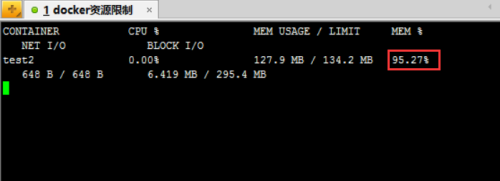

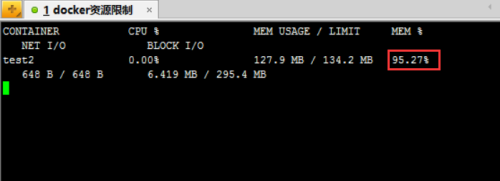

通过 docker stats 可以查看到容器的内存已经满负载了。

#docker stats test2

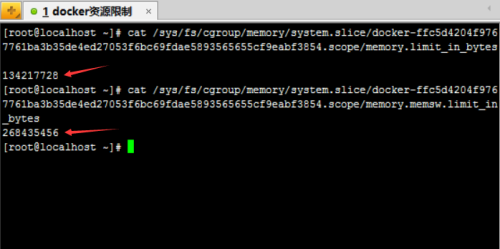

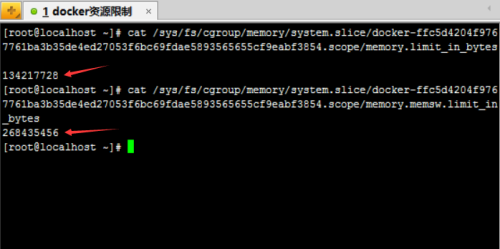

对上面的命令创建的容器,可以查看到在 cgroups 的配置文件中,查看到容器的内存大小为

128MB (128×1024×1024=134217728B),内 存 和 swap 加 起 来 大 小 为 256MB

(256×1024×1024=268435456B)。

#cat/sys/fs/cgroup/memory/system.slice/docker-<容器的完整ID>/memory.limit_in_bytes

134217728

#cat /sys/fs/cgroup/memory/system.slice/docker-< 容 器 的 完 整

ID>/memory.memsw.limit_in_bytes

268435456

磁盘 IO 配额控制

主要包括以下参数:

--device-read-bps:限制此设备上的读速度(bytesper second),单位可以是 kb、mb 或者 gb。

--device-read-iops:通过每秒读 IO 次数来限制指定设备的读速度。

--device-write-bps :限制此设备上的写速度(bytesper second),单位可以是 kb、mb 或者 gb。

--device-write-iops:通过每秒写 IO 次数来限制指定设备的写速度。

--blkio-weight:容器默认磁盘 IO 的加权值,有效值范围为10-1000。

--blkio-weight-device: 针对特定设备的 IO 加权控制。其格式为DEVICE_NAME:WEIGHT

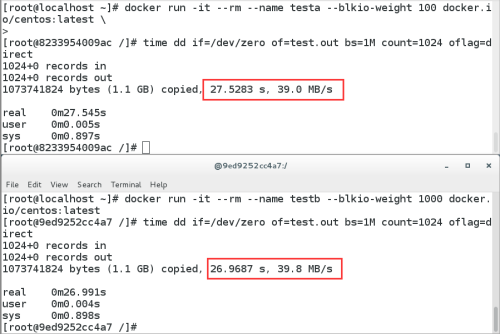

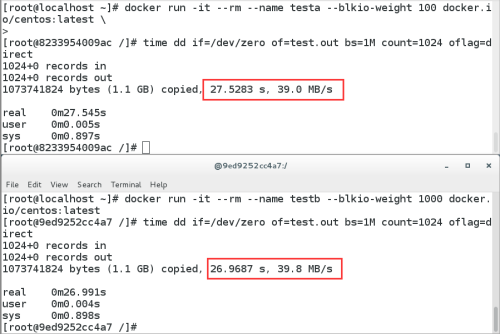

磁盘 IO 配额控制示例

blkio-weight

使用下面的命令创建两个–blkio-weight 值不同的容器:

在容器中同时执行下面的 dd 命令,进行测试

注:oflag=direct 规避掉文件系统的 cache,把写请求直接封装成 io 指令发到硬盘

附件:http://down.51cto.com/data/2368539

一、本文将介绍 cgroup 如何做到内存,cpu 和 io 速率的隔离

本文用脚本运行示例进程,来验证 Cgroups 关于 cpu、内存、io 这三部分的隔离效果。

测试机器环境

执行 mount 命令查看 cgroup 的挂载点

从上图可以看到 cgroup 挂载在/sys/fs/cgroup 目录

groups 可以限制 blkio、cpu、cpuacct、cpuset、devices、freezer、memory、net_cls、ns 等系

统的资源,以下是主要子系统的说明:

blkio 这个子系统设置限制每个块设备的输入输出控制。例如:磁盘,光盘以及 usb 等等。

cpu 这个子系统使用调度程序为 cgroup 任务提供 cpu 的访问。

cpuacct 产生 cgroup 任务的 cpu 资源报告。

cpuset 如果是多核心的 cpu,这个子系统会为cgroup 任务分配单独的 cpu 和内存。

devices 允许或拒绝 cgroup 任务对设备的访问。

freezer 暂停和恢复 cgroup 任务。

memory 设置每个 cgroup 的内存限制以及产生内存资源报告。

net_cls 标记每个网络包以供 cgroup 方便使用,它通过使用等级识别符(classid)标记网络数

据包,从而允许 Linux 流量控制程序(TC:Traffic Controller)识别从具体 cgroup 中生成

的数据包。

ns:命名空间子系统

cgroups 管理进程 cpu 资源

我们先看一个限制 cpu 资源的例子:

跑一个耗 cpu 的脚本

运行一个容器,在容器内创建脚本并运行脚本,脚本内容:

将容器切换到后台运行

在宿主机上 top 可以看到这个脚本基本占了 90%多的 cpu 资源

下面用 cgroups 控制这个进程的 cpu 资源

对于 centos7 来说,通过 systemd-cgls 来查看系统 cgroups tree:

#systemd-cgls

注:4239 就是我们所运行的容器 pid

将 cpu.cfs_quota_us 设为 50000,相对于 cpu.cfs_period_us 的 100000 是 50%

进入容器,再次执行脚本,打开宿主机的另一个终端执行 top 命令

然后 top 的实时统计数据如下,cpu 占用率将近 50%,看来 cgroups 关于 cpu 的控制起了效果

CPU 资源控制

CPU 资源的控制也有两种策略,一种是完全公平调度 (CFS:CompletelyFair Scheduler)

策略,提供了限额和按比例分配两种方式进行资源控制;另一种是实时调度(Real-Time

Scheduler)策略,针对实时进程按周期分配固定的运行时间。配置时间都以微秒(μs)为

单位,文件名中用 us 表示。

CFS 调度策略下的配置

按权重比例设定 CPU 的分配

docker 提供了–cpu-shares 参数,在创建容器时指定容器所使用的 CPU 份额值。例如:

使用命令 docker run -tid –cpu-shares 100 镜像,创建容器,则最终生成的 cgroup 的 cpu 份额

配置可以下面的文件中找到:

cpu-shares 的值不能保证可以获得 1 个 vcpu 或者多少 GHz 的 CPU 资源,仅仅只是一个加权

值。

该加权值是一个整数(必须大于等于 2)表示相对权重,最后除以权重总和算出相对比例,

按比例分配 CPU 时间。

默认情况下,每个 docker 容器的 cpu 份额都是 1024。单独一个容器的份额是没有意义的,

只有在同时运行多个容器时,容器的 cpu 加权的效果才能体现出来。例如,两个容器 A、B

的 cpu 份额分别为 1000 和 500,在 cpu 进行时间片分配的时候,容器 A 比容器 B 多一倍的

机会获得 CPU 的时间片。如果容器 A 的进程一直是空闲的,那么容器 B 是可以获取比容器

A 更多的 CPU 时间片的。极端情况下,比如说主机上只运行了一个容器,即使它的 cpu 份额

只有 50,它也可以独占整个主机的 cpu 资源。

cgroups 只在容器分配的资源紧缺时,也就是说在需要对容器使用的资源进行限制时,才会

生效。因此,无法单纯根据某个容器的 cpu 份额来确定有多少 cpu 资源分配给它,资源分配

结果取决于同时运行的其他容器的 cpu 分配和容器中进程运行情况。

cpu-shares 演示案例:

先删除 docker 主机上运行的容器

Docker 通过--cpu-shares 指定 CPU 份额

运行一个容器指定 cpu 份额为 1024

注:

--cpu-shares 指定 CPU 份额,默认就是 1024

--cpuset-cpus 可以绑定 CPU。例如,指定容器在--cpuset-cpus0,1 或--cpuset-cpus 0-3

--cpu 是 stress 命令的选项表示产生 n 个进程 每个进程都反复不停的计算随机数的平方根

stress 命令是 linux 下的一个压力测试工具。

在 docker 宿主机上打开一个 terminal 执行 top

查看 top 的现实结果

可以看到 container1 的 CPU 占比为 1024/(1024+512)=2/3,container2 的 CPU 占比为

512/(1024+512)=1/3

将 container1 的 cpu.shares 改为 512,

#echo “512” >/sys/fs/cgroup/cpu/system.slice/docker-<容器的完整长ID>/cpu.shares

可以看到两个容器的 CPU 占比趋于平均

设定 CPU 使用周期使用时间上限

cgroups 里,可以用cpu.cfs_period_us 和 cpu.cfs_quota_us 来限制该组中的所有进程在单

位时间里可以使用的 cpu 时间。cpu.cfs_period_us 就是时间周期,默认为 100000,即百毫

秒。cpu.cfs_quota_us 就是在这期间内可使用的 cpu 时间,默认 -1,即无限制。

cpu.cfs_period_us:设定时间周期(单位为微秒(μs)),必须与 cfs_quota_us 配合使用。

cpu.cfs_quota_us :设定周期内最多可使用的时间(单位为微秒(μs))。这里的配置指 task

对单个 cpu 的使用上限。

举个例子,如果容器进程需要每 1 秒使用单个 CPU 的 0.2 秒时间,可以将 cpu-period 设置为

1000000(即 1 秒),cpu-quota 设置为 200000(0.2 秒)。

当然,在多核情况下,若 cfs_quota_us 是 cfs_period_us 的两倍,就表示在两个核上

完全使用 CPU,例如如果允许容器进程需要完全占用两个 CPU,则可以将 cpu-period 设置为

100000(即 0.1 秒),cpu-quota 设置为 200000(0.2 秒)。

使用示例:

使用命令 docker run 创建容器

在宿主机上执行 top

从上图可以看到基本占了 100%的 cpu 资源

则最终生成的 cgroup 的 cpu 周期配置可以下面的目录中找到:

/sys/fs/cgroup/cpu/system.slice/docker-<容器的完整长ID>/

修改容器的 cpu.cfs_period_us 和 cpu.cfs_quota_us 值

执行 top 查看 cpu 资源

从上图可以看到基本占了 50%的 cpu 资源

RT 调度策略下的配置 实时调度策略与公平调度策略中的按周期分配时间的方法类似,也是

在周期内分配一个固定的运行时间。

cpu.rt_period_us :设定周期时间。

cpu.rt_runtime_us:设定周期中的运行时间。

cpuset - CPU 绑定

对多核 CPU 的服务器,docker 还可以控制容器运行限定使用哪些 cpu 内核和内存节点,即

使用–cpuset-cpus 和–cpuset-mems 参数。对具有 NUMA 拓扑(具有多 CPU、多内存节点)的

服务器尤其有用,可以对需要高性能计算的容器进行性能最优的配置。如果服务器只有一个

内存节点,则–cpuset-mems 的配置基本上不会有明显效果

注:

现在的机器上都是有多个 CPU 和多个内存块的。以前我们都是将内存块看成是一大块内存,

所有 CPU 到这个共享内存的访问消息是一样的。但是随着处理器的增加,共享内存可能会

导致内存访问冲突越来越厉害,且如果内存访问达到瓶颈的时候,性能就不能随之增加。

NUMA(Non-Uniform MemoryAccess)就是这样的环境下引入的一个模型。比如一台机

器是有2个处理器,有4个内存块。我们将1个处理器和两个内存块合起来,称为一个NUMAnode,这样这个机器就会有两个 NUMAnode。在物理分布上,NUMA node 的处理器和内

存块的物理距离更小,因此访问也更快。比如这台机器会分左右两个处理器(cpu1, cpu2),

在每个处理器两边放两个内存块(memory1.1, memory1.2, memory2.1,memory2.2),这样

NUMA node1 的 cpu1 访问 memory1.1 和 memory1.2 就比访问memory2.1 和 memory2.2

更快。所以使用 NUMA 的模式如果能尽量保证本 node 内的 CPU 只访问本 node 内的内存

块,那这样的效率就是最高的。

使用示例:

表示创建的容器只能用 0、1、2 这三个内核。最终生成的 cgroup 的 cpu 内核配置如下:

cpuset.cpus:在这个文件中填写 cgroup 可使用的 CPU 编号,如 0-2,16 代表 0、1、2 和 16

这 4 个 CPU。

cpuset.mems:与 CPU 类似,表示 cgroup 可使用的 memorynode,格式同上

通过 docker exec <容器 ID> taskset -c -p 1(容器内部第一个进程编号一般为 1),可以看到容器

中进程与 CPU 内核的绑定关系,可以认为达到了绑定 CPU 内核的目的。

总结:

CPU 配额控制参数的混合使用

当上面这些参数中时,cpu-shares 控制只发生在容器竞争同一个内核的时间片时,如果通过

cpuset-cpus 指定容器 A 使用内核 0,容器 B 只是用内核 1,在主机上只有这两个容器使用对

应内核的情况,它们各自占用全部的内核资源,cpu-shares 没有明显效果。

cpu-period、cpu-quota 这两个参数一般联合使用,在单核情况或者通过 cpuset-cpus 强制容

器使用一个 cpu 内核的情况下,即使 cpu-quota 超过 cpu-period,也不会使容器使用更多的

CPU 资源。

cpuset-cpus、cpuset-mems 只在多核、多内存节点上的服务器上有效,并且必须与实际的物

理配置匹配,否则也无法达到资源控制的目的。

在系统具有多个 CPU 内核的情况下,需要通过 cpuset-cpus 为容器 CPU 内核才能比较方便地

进行测试。

内存配额控制

和 CPU 控制一样,docker 也提供了若干参数来控制容器的内存使用配额,可以控制容器的

swap 大小、可用内存大小等各种内存方面的控制。主要有以下参数:

Docker 提供参数-m,--memory=""限制容器的内存使用量,如果不设置-m,则默认容器内存

是不设限的,容器可以使用主机上的所有空闲内存

内存配额控制使用示例

设置容器的内存上限,参考命令如下所示

#docker run -dit --memory 128m 镜像

默认情况下,除了–memory 指定的内存大小以外,docker 还为容器分配了同样大小的 swap

分区,也就是说,上面的命令创建出的容器实际上最多可以使用 256MB 内存,而不是 128MB内存。如果需要自定义 swap 分区大小,则可以通过联合使用–memory–swap 参数来实现控

制。

可以发现,使用 256MB 进行压力测试时,由于超过了内存上限(128MB 内存+128MB swap),

进程被 OOM(out of memory)杀死。

使用 250MB 进行压力测试时,进程可以正常运行。

通过 docker stats 可以查看到容器的内存已经满负载了。

#docker stats test2

对上面的命令创建的容器,可以查看到在 cgroups 的配置文件中,查看到容器的内存大小为

128MB (128×1024×1024=134217728B),内 存 和 swap 加 起 来 大 小 为 256MB

(256×1024×1024=268435456B)。

#cat/sys/fs/cgroup/memory/system.slice/docker-<容器的完整ID>/memory.limit_in_bytes

134217728

#cat /sys/fs/cgroup/memory/system.slice/docker-< 容 器 的 完 整

ID>/memory.memsw.limit_in_bytes

268435456

磁盘 IO 配额控制

主要包括以下参数:

--device-read-bps:限制此设备上的读速度(bytesper second),单位可以是 kb、mb 或者 gb。

--device-read-iops:通过每秒读 IO 次数来限制指定设备的读速度。

--device-write-bps :限制此设备上的写速度(bytesper second),单位可以是 kb、mb 或者 gb。

--device-write-iops:通过每秒写 IO 次数来限制指定设备的写速度。

--blkio-weight:容器默认磁盘 IO 的加权值,有效值范围为10-1000。

--blkio-weight-device: 针对特定设备的 IO 加权控制。其格式为DEVICE_NAME:WEIGHT

磁盘 IO 配额控制示例

blkio-weight

使用下面的命令创建两个–blkio-weight 值不同的容器:

在容器中同时执行下面的 dd 命令,进行测试

注:oflag=direct 规避掉文件系统的 cache,把写请求直接封装成 io 指令发到硬盘

附件:http://down.51cto.com/data/2368539

相关文章推荐

- docker高级应用之cpu与内存资源限制(转)

- docker高级应用之网络资源限制

- docker技术剖析--docker资源限制及应用总结 推荐

- docker资源限制及应用总结

- docker 资源限制以及应用的总结 推荐

- docker技术剖析--docker资源限制及应用总结 for centos7.2

- docker高级应用之cpu与内存资源限制(转)

- docker资源限制和应用总结

- docker高级应用之cpu与内存资源限制

- docker高级应用之资源监控

- 软件评测-信息安全-应用安全-资源控制-用户登录限制(中)

- 软件评测-信息安全-应用安全-资源控制-用户登录限制(上)

- Docker背后的内核知识——cgroups资源限制

- Docker CPU 资源限制——CPU固定核功能测试

- docker资源限制

- Docker 资源限制之 CPU

- 理解Docker(4):Docker 容器使用 cgroups 限制资源使用

- docker 的资源限制 总结

- 软件评测-信息安全-应用安全-资源控制-用户登录限制(中)

- 软件评测-信息安全-应用安全-资源控制-用户登录限制(上)