《神经网络和深度学习》系列文章十二:Hadamard积,s⊙t

2015-11-17 12:17

447 查看

出处: Michael Nielsen的《Neural Network and Deep Learning》,点击末尾“阅读原文”即可查看英文原文。

本节译者:哈工大SCIR本科生 王宇轩

声明:我们将在每周一,周四 定期连载该书的中文翻译,如需转载请联系wechat_editors@ir.hit.edu.cn,未经授权不得转载。

使用神经网络识别手写数字

反向传播算法是如何工作的

热身:一个基于矩阵的快速计算神经网络输出的方法

关于损失函数的两个假设

Hadamard积

反向传播背后的四个基本等式

四个基本等式的证明(选读)

反向传播算法

什么时候反向传播算法高效

反向传播算法再理解

改进神经网络的学习方法

神经网络能够计算任意函数的视觉证明

为什么深度神经网络的训练是困难的

深度学习

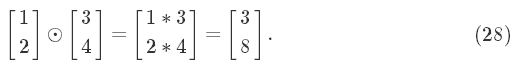

反向传播算法是以常见线性代数操作为基础——诸如向量加法,向量与矩阵乘法等运算。但其中一个操作相对不是那么常用。具体来讲,假设s和t是两个有相同维数的向量。那么我们用s⊙t来表示两个向量的对应元素(elementwise)相乘。因此s⊙t的元素(s⊙t)j=sjtj。例如,

这种对应元素相乘有时被称为Hadamard积(Hadamard product)或Schur积(Schur product)。我们将称它为Hadamard积。优秀的矩阵库通常会提供Hadamard积的快速实现,这在实现反向传播时将会有用。

下一节我们将介绍“反向传播背后的四个基本等式”,敬请关注!

“哈工大SCIR”公众号

编辑部:郭江,李家琦,徐俊,李忠阳,俞霖霖

本期编辑:俞霖霖

本节译者:哈工大SCIR本科生 王宇轩

声明:我们将在每周一,周四 定期连载该书的中文翻译,如需转载请联系wechat_editors@ir.hit.edu.cn,未经授权不得转载。

使用神经网络识别手写数字

反向传播算法是如何工作的

热身:一个基于矩阵的快速计算神经网络输出的方法

关于损失函数的两个假设

Hadamard积

反向传播背后的四个基本等式

四个基本等式的证明(选读)

反向传播算法

什么时候反向传播算法高效

反向传播算法再理解

改进神经网络的学习方法

神经网络能够计算任意函数的视觉证明

为什么深度神经网络的训练是困难的

深度学习

反向传播算法是以常见线性代数操作为基础——诸如向量加法,向量与矩阵乘法等运算。但其中一个操作相对不是那么常用。具体来讲,假设s和t是两个有相同维数的向量。那么我们用s⊙t来表示两个向量的对应元素(elementwise)相乘。因此s⊙t的元素(s⊙t)j=sjtj。例如,

这种对应元素相乘有时被称为Hadamard积(Hadamard product)或Schur积(Schur product)。我们将称它为Hadamard积。优秀的矩阵库通常会提供Hadamard积的快速实现,这在实现反向传播时将会有用。

下一节我们将介绍“反向传播背后的四个基本等式”,敬请关注!

“哈工大SCIR”公众号

编辑部:郭江,李家琦,徐俊,李忠阳,俞霖霖

本期编辑:俞霖霖

相关文章推荐

- 《神经网络和深度学习》系列文章十一:关于损失函数的两个假设

- 《神经网络和深度学习》系列文章十:[热身]一个基于矩阵的快速计算神经网络输出的方法

- 《神经网络和深度学习》系列文章九:反向传播算法是如何工作的

- 《神经网络和深度学习》系列文章八:迈向深度学习

- 《神经网络和深度学习》系列文章七:实现我们的神经网络来分类数字(下)

- 《神经网络和深度学习》系列文章七:实现我们的神经网络来分类数字(上)

- 《神经网络和深度学习》系列文章六:通过梯度下降法学习参数

- 《神经网络和深度学习》系列文章五:用简单的网络结构解决手写数字识别

- 《神经网络和深度学习》系列文章四:神经网络的结构

- 《神经网络和深度学习》系列文章三:sigmoid神经元

- 《神经网络和深度学习》系列文章二:感知机

- 《神经网络和深度学习》系列文章一:使用神经网络识别手写数字

- 关于Socket理解

- AlertDialog对话框自定义大小,加载网络请求,点击不消失

- Linux服务器上安装使用TCPCopy来获取用户访问流量

- 【Ajax 2】封装Ajax的核心对象:XMLHttpRequest对象

- 【Ajax 2】封装Ajax的核心对象:XMLHttpRequest对象

- HTTP Status Code

- SAN存储网络

- Ubuntu下的抓包工具tcpdump